在人工智能浪潮席卷全球的今天,计算能力正成为驱动创新的核心引擎。作为全球图形处理器(GPU)和人工智能计算的领军者,英伟达(NVIDIA)正以前所未有的速度,引领着从硬件到软件、从模型训练到应用部署的全栈式变革。其核心战略,即“人工智能计算加速”,不仅体现在其不断突破性能极限的硬件产品上,更深刻地体现在它如何彻底重塑人工智能应用软件开发的格局。

一、硬件基石:算力爆炸与专用架构

英伟达的加速计算之旅始于其GPU架构的持续演进。从专为图形渲染设计的架构,到为通用并行计算优化的CUDA核心,再到如今专为人工智能和高性能计算(HPC)打造的Tensor Core和Transformer Engine,英伟达通过硬件层面的深度定制,实现了算力的指数级增长。其H100、GH200 Grace Hopper超级芯片以及最新的Blackwell架构平台,将训练和推理超大规模AI模型的能力提升到了新的高度。这为复杂的人工智能应用,如大语言模型、蛋白质结构预测、数字孪生和自动驾驶,提供了不可或缺的“燃料”。没有强大的底层算力支撑,任何前沿的AI应用构想都只能是空中楼阁。

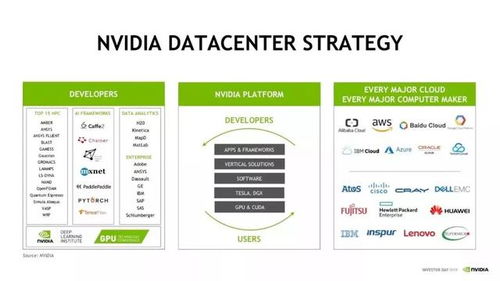

二、软件生态:CUDA与AI工厂的“操作系统”

如果说硬件是引擎,那么软件就是让引擎高效运转的精密控制系统。英伟达最深远的影响之一,在于其构建的庞大、成熟的软件生态系统。CUDA并行计算平台是其皇冠上的明珠,它让开发者能够便捷地利用GPU的强大并行能力,将AI计算加速从理论变为普及化的实践。

更进一步,英伟达推出了NVIDIA AI Enterprise软件套件,它堪称“AI工厂”的操作系统。这套工具集涵盖了从数据准备、模型训练、优化到大规模部署和管理的全生命周期。例如:

- NVIDIA NeMo:一个用于构建、定制和部署大语言模型的端到端云原生框架,极大简化了生成式AI应用的开发流程。

- NVIDIA TAO Toolkit:提供低代码的迁移学习工具,让开发者能用少量数据快速微调预训练模型,加速计算机视觉和对话式AI应用的落地。

- NVIDIA Triton推理服务器:一个开源的AI模型推理服务软件,支持在CPU、GPU等任何硬件上部署来自TensorFlow、PyTorch等任何框架训练的模型,解决了生产环境中模型部署复杂、异构环境兼容性差的痛点。

这些软件工具的核心目标,是将AI应用开发从“手工作坊”模式,升级为标准化、自动化的“工业化”流水线。开发者不再需要耗费大量精力处理底层硬件兼容、性能优化和集群管理问题,而是可以专注于应用本身的创新逻辑。

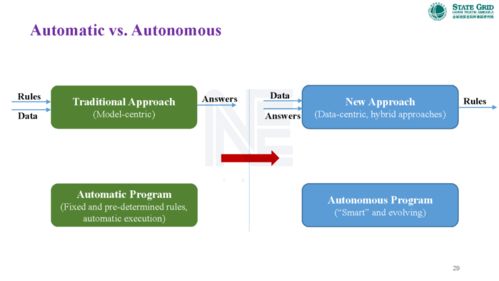

三、重塑应用软件开发范式

在英伟达计算加速的全栈赋能下,人工智能应用软件开发呈现出几个鲜明的新趋势:

- 从“通用计算”到“加速计算优先”:新一代应用软件在设计之初,就将GPU加速作为核心架构假设。无论是科学计算、金融分析、还是内容创作工具,利用CUDA或特定AI库进行加速已成为提升竞争力的关键。

- 云原生与微服务化:AI应用,特别是推理服务,正日益成为云原生微服务架构的一部分。借助Triton等工具,AI模型可以像容器化应用一样被灵活部署、扩展和管理,无缝融入现代DevOps流程。

- 低代码与民主化:英伟达的TAO、NIM(预构建的AI模型微服务)等工具,显著降低了专业AI模型定制和部署的门槛。领域专家(如医生、工程师)即使不具备深厚的机器学习背景,也能利用这些工具开发出解决专业问题的AI应用,加速了AI技术向垂直行业的渗透。

- 实时性与交互性成为可能:强大的推理加速使得过去无法实现的实时AI应用成为现实。例如,实时视频内容分析、高保真交互式虚拟数字人、毫秒级延迟的语音对话助手等,这些应用正在重新定义用户体验。

四、挑战与未来展望

尽管前景广阔,加速计算下的AI应用开发仍面临挑战:硬件成本、对特定硬件生态的依赖、能源消耗以及日益复杂的全栈技术栈对开发者的综合能力提出了更高要求。

英伟达的加速计算战略将继续深化。其愿景是通过Omniverse平台连接数字世界与物理世界,通过AI和仿真技术构建元宇宙的基础设施;通过医疗、气候等领域的专用框架,推动AI for Science的进步。对于软件开发者和企业而言,拥抱以英伟达为代表的加速计算生态,不仅是获取当前顶尖AI能力的捷径,更是为未来构建下一代智能应用奠定了基石。

****

英伟达的“人工智能计算加速”远不止是芯片性能的竞赛,它是一场从底层硬件到顶层应用、从开发工具到行业标准的系统性革命。它正在将人工智能从实验室和科技巨头的专属领域,转变为一项可被广大开发者和各行各业广泛采用的通用技术。在这个加速进行时的时代,应用软件的开发逻辑已被重写,而英伟达,正是那位最重要的执笔人与赋能者。